Incorporating Sememes into Chinese Definition Modeling

2019

Linear Yang et al.

Motivation

Chinese Definition Modeling(CDM) 任务:为给定的中文词产生词典式的中文定义

This work

- 为了解决CDM任务,构建了一个CDM数据集,每个example由

<word, sememes, definition>三元组组成 - 两个新模型

- 1、Adaptive-Attention Model(AAM):利用adaptive注意力机制结合sememes(义原)信息生成 Definition

- 2、Self- and Adaptive-Attention Model(SAAM ):进一步使用self-attention替代AAM中的recurrent connection,减少word,sememes,definition之间的路径长度

Methodology

Chinese Definition Modeling Corpus:

- 包含 104,517 个条目

- 三元组:

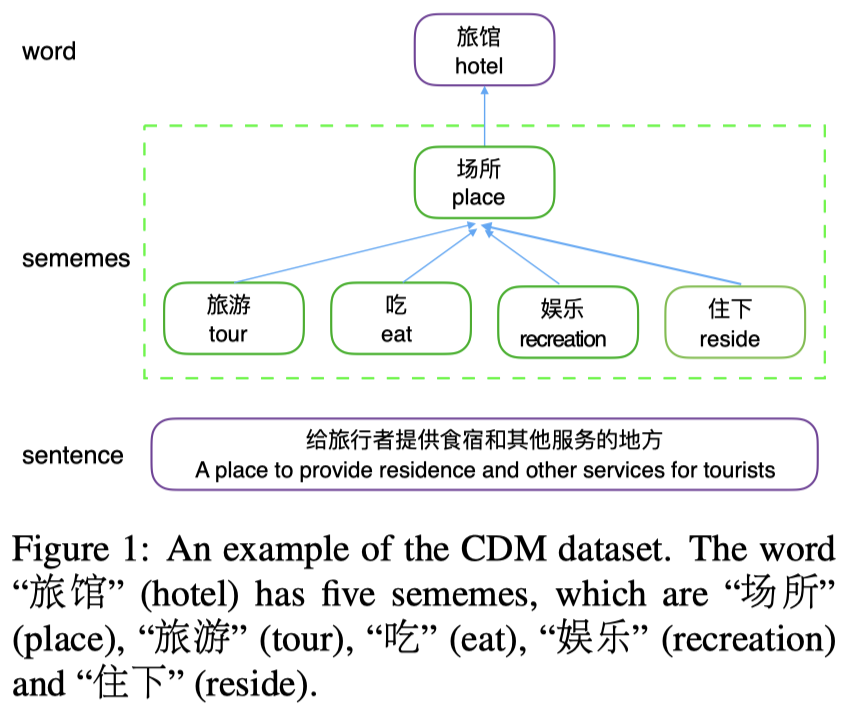

<a word, the sememes of a specific word sense, and the definition in Chinese of the same word sense> - Sememes:义原,是描述词义的最小的语义单位

- 具体信息请参考:HowNet

- 为什么要使用义原:可以为生成定义提供额外的语义信息

- 例子:

Model

RNN-based Seq-to-Seq Model

Adaptive-Attention Model

引入 Adaptive-Attention 的原因:

- vanilla attention 在每一步都会关于sememes

- 在生成definition的过程中,不是所有词都与sememes有关

Adaptive-Attention

- 利用 time-varying sememes 信息作为 sememe context

- LM的信息作为 LM context

- 首先,由 decoder 的 hidden state 和 上一时刻生成的definition词 通过线性映射和sigmoid运算得到 一个 gate 向量

- 再,对上一时刻的hidden state 进行tanh激活运算,通过 gated unit,得到 LM context

- 再根据 context,引入一个新的attention,决定在生成当前时刻词是依赖 sememe context 还是 LM context

Self- and Adaptive-Attention Model

将 AAM 中的 RNN,换成 transformer